| Distribuția gamma |

|---|

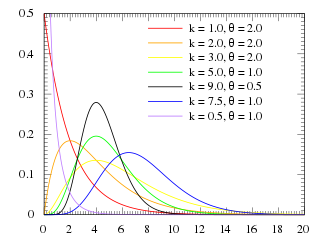

Funcția densității probabilității

|

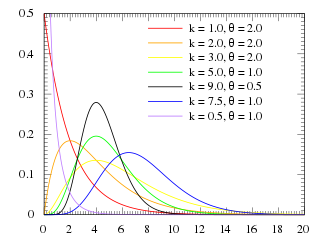

Funcția de distribuție

|

| Parametrii | {\ displaystyle k> 0 \}  Și {\ displaystyle \ theta> 0 \} Și {\ displaystyle \ theta> 0 \}

sau

{\ displaystyle \ alpha> 0 \}  Și {\ displaystyle \ beta> 0 \} Și {\ displaystyle \ beta> 0 \}

( {\ displaystyle k = \ alpha}  , {\ displaystyle \ theta \ beta = 1} , {\ displaystyle \ theta \ beta = 1}  ) ) |

|---|

| A sustine | {\ displaystyle \ mathbb {R} ^ {+}}  |

|---|

| Funcția de densitate | {\ displaystyle {\ frac {x ^ {k-1} e ^ {- {\ frac {x} {\ theta}}}} {\ theta ^ {k} \ Gamma (k)}}}

(cu {\ displaystyle \ Gamma}  funcția Gamma ) funcția Gamma ) |

|---|

| Funcția de distribuție | {\ displaystyle P (k, x) = {\ frac {\ gamma (k, x / \ theta)} {\ Gamma (k)}}}

( {\ displaystyle \ gamma}  este funcția Gamma incompletă incompletă regularizată) este funcția Gamma incompletă incompletă regularizată) |

|---|

| Valorea estimata | {\ displaystyle k \ theta \}  |

|---|

| Modă | {\ displaystyle (k-1) \ theta \}  de sine {\ displaystyle k \ geq 1} de sine {\ displaystyle k \ geq 1}  |

|---|

| Varianța | {\ displaystyle k \ theta ^ {2} \}  |

|---|

| Indicele de asimetrie | {\ displaystyle {\ frac {2} {\ sqrt {k}}}}  |

|---|

| Curios | {\ displaystyle {\ frac {6} {k}}}  |

|---|

| Entropie | {\ displaystyle k + \ ln \ theta + \ ln \ Gamma (k) + (1-k) \ psi _ {0} (k)}

(cu {\ displaystyle \ psi _ {0}}  funcția digamă ) funcția digamă ) |

|---|

| Funcție generatoare de momente | {\ displaystyle (1- \ theta t) ^ {- k} \}  pentru {\ displaystyle t <\ theta ^ {- 1}} pentru {\ displaystyle t <\ theta ^ {- 1}}  |

|---|

| Funcția caracteristică | {\ displaystyle (1-i \ theta t) ^ {- k} \}  |

|---|

| Manual |

În teoria probabilității , distribuția Gamma este o distribuție continuă a probabilității , care include, ca cazuri particulare, și distribuțiile exponențiale și chi-pătrate .

Este folosit ca model general al timpilor de așteptare în teoria cozilor, mai ales atunci când există efecte importante care elimină „lipsa memoriei” distribuției exponențiale. În statisticile bayesiene este comun atât ca distribuție a priori, cât și a posteriori .

Definiție

Distribuția Gamma este distribuția probabilității variabilei aleatorii definită ca suma variabilelor aleatoare independente cu distribuție exponențială; distribuția Gamma este o distribuție de probabilitate definită pe numere reale pozitive, {\ displaystyle \ mathbb {R} ^ {+}}  . În funcție de autori, acesta este parametrizat în două moduri diferite: fie prin perechea de numere pozitive {\ displaystyle (k, \ theta)}

. În funcție de autori, acesta este parametrizat în două moduri diferite: fie prin perechea de numere pozitive {\ displaystyle (k, \ theta)}  , atât prin perechea de numere pozitive {\ displaystyle (\ alpha, \ beta)}

, atât prin perechea de numere pozitive {\ displaystyle (\ alpha, \ beta)}  . Cele două parametrizări sunt legate de relații {\ displaystyle \ alpha = k}

. Cele două parametrizări sunt legate de relații {\ displaystyle \ alpha = k}  Și {\ displaystyle \ beta = 1 / \ theta}

Și {\ displaystyle \ beta = 1 / \ theta}  . În cele ce urmează ne vom referi la parametrizarea Gamma {\ displaystyle (k, \ theta)}

. În cele ce urmează ne vom referi la parametrizarea Gamma {\ displaystyle (k, \ theta)}  .

.

Funcția sa de densitate a probabilității este

- {\ displaystyle f (x) = {\ frac {1} {\ theta ^ {k} \ Gamma (k)}} x ^ {k-1} e ^ {- {\ frac {x} {\ theta}} } = {\ frac {\ beta ^ {\ alpha}} {\ Gamma (\ alpha)}} x ^ {\ alpha -1} e ^ {- \ beta x}}

,

,

unde este {\ displaystyle \ Gamma (k) = \ int _ {0} ^ {\ infty} t ^ {k-1} e ^ {- t} dt}  este funcția Gamma a lui Euler.

este funcția Gamma a lui Euler.

Putem observa că dacă {\ displaystyle k \ in \ mathbb {N}}  merită asta {\ displaystyle \ Gamma (k) = (k-1)!}

merită asta {\ displaystyle \ Gamma (k) = (k-1)!}

Funcția sa de distribuție este funcția gamma incompletă regularizată inferioară

- {\ displaystyle F (x) = P (k, x) = {\ frac {\ gamma (k, x / \ theta)} {\ Gamma (k)}} = {\ frac {\ gamma (\ alpha, \ beta x)} {\ Gamma (\ alpha)}}}

,

,

unde este {\ displaystyle \ gamma (k, x) = \ int _ {0} ^ {x} t ^ {k-1} e ^ {- t} dt}  este funcția Gamma incompletă incompletă.

este funcția Gamma incompletă incompletă.

Caracteristici

Momentele simple ale intervalului Parametrii de distribuție {\ displaystyle (k, \ theta)}  Sunt

Sunt

- {\ displaystyle \ mu _ {n} = \ mathbb {E} [X ^ {n}] = {\ tfrac {1} {\ theta ^ {k} \ Gamma (k)}} \ int _ {0} ^ {\ infty} x ^ {k + n-1} e ^ {- {\ frac {x} {\ theta}}} dx}

![{\ displaystyle \ mu _ {n} = \ mathbb {E} [X ^ {n}] = {\ tfrac {1} {\ theta ^ {k} \ Gamma (k)}} \ int _ {0} ^ {\ infty} x ^ {k + n-1} e ^ {- {\ frac {x} {\ theta}}} dx}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a8277ca0c5f22c9f11b60902d64458169995ac72)

- {\ displaystyle \ mu _ {n} = {\ tfrac {\ theta ^ {k + n-1}} {\ theta ^ {k-1} \ Gamma (k)}} \ int _ {0} ^ {\ infty} u ^ {k + n-1} e ^ {- u} du = \ theta ^ {n} {\ frac {\ Gamma (k + n)} {\ Gamma (k)}} = \ theta ^ { n} \ prod _ {i = 0} ^ {n-1} (k + i),}

unde efectuați înlocuirea obișnuită {\ displaystyle {\ frac {x} {\ theta}} = u}  pentru a obține reprezentarea integrală a funcției Gamma a lui Euler.

pentru a obține reprezentarea integrală a funcției Gamma a lui Euler.

În special, distribuția are:

- valorea estimata {\ displaystyle \ mathbb {E} [X] = k \ theta;}

![{\ displaystyle \ mathbb {E} [X] = k \ theta;}](https://wikimedia.org/api/rest_v1/media/math/render/svg/6cddf8c6de2a11a11f196f858b0f414cee055d86)

- varianță {\ displaystyle \ mathrm {Var} (X) = k \ theta ^ {2};}

- indicele de asimetrie {\ displaystyle \ gamma _ {1} = 2 \, k ^ {- {\ frac {1} {2}}};}

- indicele kurtozei {\ displaystyle \ gamma _ {2} = 6 \, k ^ {- 1}.}

Funcția de generare a momentului:

- {\ displaystyle \ mathbb {M} _ {X} (t) = \ mathbb {E} [e ^ {tX}] = {\ frac {1} {\ theta ^ {k} \ Gamma (k)}} \ int _ {0} ^ {\ infty} x ^ {k-1} e ^ {- x \ left ({\ frac {1} {\ theta}} - t \ right)} dx = {\ frac {1} {\ theta ^ {k} \ Gamma (k) ({\ tfrac {1} {\ theta}} - t) ^ {k}}} \ int _ {0} ^ {\ infty} u ^ {k-1 } și ^ {- u} du}

![{\ displaystyle \ mathbb {M} _ {X} (t) = \ mathbb {E} [e ^ {tX}] = {\ frac {1} {\ theta ^ {k} \ Gamma (k)}} \ int _ {0} ^ {\ infty} x ^ {k-1} e ^ {- x \ left ({\ frac {1} {\ theta}} - t \ right)} dx = {\ frac {1} {\ theta ^ {k} \ Gamma (k) ({\ tfrac {1} {\ theta}} - t) ^ {k}}} \ int _ {0} ^ {\ infty} u ^ {k-1 } și ^ {- u} du}](https://wikimedia.org/api/rest_v1/media/math/render/svg/229dbeb785cca82ca8dea2623c941173a8164f12)

- {\ displaystyle \ mathbb {M} _ {X} (t) = (1- \ theta t) ^ {- k}}

care există pentru orice valoare a t astfel încât {\ displaystyle 1- \ theta t> 0 \ Rightarrow t <\ theta ^ {- 1}.}

care există pentru orice valoare a t astfel încât {\ displaystyle 1- \ theta t> 0 \ Rightarrow t <\ theta ^ {- 1}.}

Proprietăți (teorema schimbării scalei)

De sine {\ displaystyle X}  urmează distribuția Gamma {\ displaystyle (k, \ theta)}

urmează distribuția Gamma {\ displaystyle (k, \ theta)}  asa de {\ displaystyle aX}

asa de {\ displaystyle aX}  urmează distribuția Gamma {\ displaystyle (k, a \ theta)}

urmează distribuția Gamma {\ displaystyle (k, a \ theta)}  .

.

De sine {\ displaystyle X_ {1}, \ ldots, X_ {n}}  sunt variabile aleatoare independente , fiecare cu o distribuție Gamma {\ displaystyle (k_ {i}, \ theta)}

sunt variabile aleatoare independente , fiecare cu o distribuție Gamma {\ displaystyle (k_ {i}, \ theta)}  , apoi suma lor {\ displaystyle X_ {1} + \ ldots + X_ {n}}

, apoi suma lor {\ displaystyle X_ {1} + \ ldots + X_ {n}}  urmează distribuția Gamma {\ displaystyle (k_ {1} + \ ldots + k_ {n}, \ theta)}

urmează distribuția Gamma {\ displaystyle (k_ {1} + \ ldots + k_ {n}, \ theta)}  .

.

Alte distribuții

Distribuția Gamma generalizează mai multe distribuții (acum este convenabil să utilizați a doua dintre cele două parametrizări prezentate):

- de sine {\ displaystyle k}

este un număr natural obținem distribuția Erlang ;

este un număr natural obținem distribuția Erlang ; - {\ displaystyle \ mathrm {Gamma} (1, {\ theta}) = {\ mathcal {E}} ({1 / \ theta})}

este distribuția exponențială ;

este distribuția exponențială ; - {\ displaystyle \ mathrm {Gamma} ({\ tfrac {n} {2}}, 1/2) = \ chi ^ {2} (n)}

este distribuția chi-pătrat ;

este distribuția chi-pătrat ; - de sine {\ displaystyle X}

urmează un parametru de distribuție Maxwell-Boltzmann {\ displaystyle a}

urmează un parametru de distribuție Maxwell-Boltzmann {\ displaystyle a}  asa de {\ displaystyle X ^ {2}}

asa de {\ displaystyle X ^ {2}}  se distribuie conform {\ displaystyle \ mathrm {Gamma} ({\ tfrac {3} {2}}, 2a ^ {2})}

se distribuie conform {\ displaystyle \ mathrm {Gamma} ({\ tfrac {3} {2}}, 2a ^ {2})}  .

.

În inferența bayesiană , distribuția Gamma poate descrie parametrul atât a priori, cât și a posteriori al unei observații {\ displaystyle X}  a diferitelor distribuții de probabilitate, de exemplu distribuția exponențială și distribuția Poisson .

a diferitelor distribuții de probabilitate, de exemplu distribuția exponențială și distribuția Poisson .

Distribuția Gamma inversă este distribuția inversă {\ displaystyle X ^ {- 1}}  a unei variabile aleatorii {\ displaystyle X}

a unei variabile aleatorii {\ displaystyle X}  care urmărește distribuția Gamma.

care urmărește distribuția Gamma.

De sine {\ displaystyle X}  Și {\ displaystyle Y}

Și {\ displaystyle Y}  sunt variabile aleatoare independente cu distribuții {\ displaystyle \ mathrm {Gamma} (k_ {1}, \ theta)}

sunt variabile aleatoare independente cu distribuții {\ displaystyle \ mathrm {Gamma} (k_ {1}, \ theta)}  Și {\ displaystyle \ mathrm {Gamma} (k_ {2}, \ theta)}

Și {\ displaystyle \ mathrm {Gamma} (k_ {2}, \ theta)}  , asa de {\ displaystyle Z = {\ tfrac {X} {X + Y}}}

, asa de {\ displaystyle Z = {\ tfrac {X} {X + Y}}}  Urmează distribuția beta {\ displaystyle \ mathrm {Beta} (k_ {1}, k_ {2})}

Urmează distribuția beta {\ displaystyle \ mathrm {Beta} (k_ {1}, k_ {2})}  , in timp ce {\ displaystyle {\ tfrac {X} {Y}} = {\ tfrac {Z} {1-Z}}}

, in timp ce {\ displaystyle {\ tfrac {X} {Y}} = {\ tfrac {Z} {1-Z}}}  urmează o distribuție beta de al doilea tip.

urmează o distribuție beta de al doilea tip.

Mai general vectorul {\ displaystyle {\ tfrac {1} {X_ {1} + \ ldots + X_ {n}}} (X_ {1}, \ ldots, X_ {n})}  , descris de {\ displaystyle n}

, descris de {\ displaystyle n}  variabile aleatorii independente {\ displaystyle X_ {i}}

variabile aleatorii independente {\ displaystyle X_ {i}}  a distribuțiilor {\ displaystyle \ mathrm {Gamma} (k_ {i}, \ theta)}

a distribuțiilor {\ displaystyle \ mathrm {Gamma} (k_ {i}, \ theta)}  , urmează o distribuție Dirichlet a parametrilor {\ displaystyle (k_ {1}, \ ldots, k_ {n})}

, urmează o distribuție Dirichlet a parametrilor {\ displaystyle (k_ {1}, \ ldots, k_ {n})}  .

.

O generalizare a distribuției Gamma este distribuția Wishart , care generalizează și distribuția {\ displaystyle \ chi ^ {2}}  .

.

Estimatori

Să calculăm acum câțiva estimatori care, având în vedere un eșantion Gamma probabil distribuit, ne pot oferi o estimare a parametrilor săi {\ displaystyle \ theta}  Și {\ displaystyle k}

Și {\ displaystyle k}  .

.

Un estimator corect pentru {\ displaystyle \ theta}  Și

Și

- {\ displaystyle {\ hat {\ theta}} = {\ frac {1} {nk}} \ sum _ {i = 1} ^ {n} x_ {i}.}

Estimator corect asimptotic pentru {\ displaystyle k}  Și:

Și:

- {\ displaystyle {\ hat {k}} = \ psi _ {0} ^ {- 1} \ left [\ ln \ left ({\ sqrt [{n}] {\ prod _ {i = 1} ^ {n } {\ frac {x_ {i}} {\ theta}}}} \ right) \ right] = \ psi _ {0} ^ {- 1} \ left [{\ frac {1} {n}} \ sum _ {i = 1} ^ {n} \ ln \ left ({\ frac {x_ {i}} {\ theta}} \ right) \ right].}

![{\ displaystyle {\ hat {k}} = \ psi _ {0} ^ {- 1} \ left [\ ln \ left ({\ sqrt [{n}] {\ prod _ {i = 1} ^ {n } {\ frac {x_ {i}} {\ theta}}}} \ right) \ right] = \ psi _ {0} ^ {- 1} \ left [{\ frac {1} {n}} \ sum _ {i = 1} ^ {n} \ ln \ left ({\ frac {x_ {i}} {\ theta}} \ right) \ right].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/164a62cbd805287c5254b7a8ac721ae783ba8a40)

unde este {\ displaystyle \ psi _ {0} ^ {- 1}}  este funcția inversă a funcției digamma {\ displaystyle \ psi _ {0} (k)}

este funcția inversă a funcției digamma {\ displaystyle \ psi _ {0} (k)}  definit astfel:

definit astfel:

- {\ displaystyle \ psi _ {0} (x): = {\ frac {\ Gamma '(x)} {\ Gamma (x)}} = {\ frac {d} {dx}} \ ln \ Gamma (x ).}

Dovezile folosesc metoda de maximă probabilitate , unde funcția de probabilitate dată eșantionului este

- {\ displaystyle \ {X_ {i} \} _ {i = 1} ^ {n} \ subset \ mathbb {R} ^ {+}}

- {\ displaystyle {\ mathcal {L}} (\ {X_ {i} \} | \ theta, k) = {\ frac {1} {\ theta ^ {nk} \ Gamma ^ {n} (k)}} \, \ cdot \, \ left (\ prod _ {i = 1} ^ {n} x_ {i} \ right) ^ {k-1} \, e ^ {- {\ frac {1} {\ theta} } \ sum _ {i = 1} ^ {n} x_ {i}}.}

Estimator de dovadă a {\ displaystyle \ theta}

Parametrul {\ displaystyle \ theta}  este cel mai simplu de estimat.

este cel mai simplu de estimat.

Observăm că funcția de probabilitate este peste tot pozitivă și se încadrează în limitele {\ displaystyle \ theta}  , anulați.

, anulați.

- {\ displaystyle \ lim _ {\ theta \ rightarrow 0 ^ {+}} {\ mathcal {L}} = 0}

- {\ displaystyle \ lim _ {\ theta \ rightarrow + \ infty} {\ mathcal {L}} = 0}

Prin urmare, dacă îi impunem derivata egală cu zero, dacă soluția este unică, acesta trebuie să fie neapărat un punct maxim.

- {\ displaystyle \ left ({\ frac {\ partial {\ mathcal {L}}} {\ partial \ theta}} \ right) _ {\ theta = {\ hat {\ theta}}} = {\ frac {e ^ {- {\ frac {1} {\ hat {\ theta}}} \ sum _ {i = 1} ^ {n} x_ {i}}} {\ Gamma ^ {n} (k)}} \ left (\ prod _ {i = 1} ^ {n} x_ {i} \ right) ^ {k-1} \, \ cdot \ left ({\ hat {\ theta}} ^ {- nk-2} \ sum _ {i = 1} ^ {n} x_ {i} -nk {\ hat {\ theta}} ^ {- nk-1} \ right)}

Acum este necesar să egalizăm această expresie la zero

- {\ displaystyle \ left ({\ frac {\ partial {\ mathcal {L}}} {\ partial \ theta}} \ right) _ {\ theta = {\ hat {\ theta}}} = 0 \, \ Rightarrow \, {\ hat {\ theta}} ^ {- nk-2} \ sum _ {i = 1} ^ {n} x_ {i} -nk {\ hat {\ theta}} ^ {- nk-1} = 0 \, \ Rightarrow \, {\ hat {\ theta}} = {\ frac {1} {nk}} \ sum _ {i = 1} ^ {n} x_ {i}}

Și iată estimatorul nostru de {\ displaystyle \ theta}  , care amintește foarte mult de o medie aritmetică, redefinită la parametru {\ displaystyle k}

, care amintește foarte mult de o medie aritmetică, redefinită la parametru {\ displaystyle k}  (care ne amintim că este egal cu 1 în cazul particular al distribuției exponențiale). Se poate vedea cu ușurință că valoarea preconizată a acestui estimator este exact {\ displaystyle \ theta}

(care ne amintim că este egal cu 1 în cazul particular al distribuției exponențiale). Se poate vedea cu ușurință că valoarea preconizată a acestui estimator este exact {\ displaystyle \ theta}  , dată fiind liniaritatea operatorului.

, dată fiind liniaritatea operatorului.

- {\ displaystyle \ mathbb {E} [{\ hat {\ theta}}] = \ mathbb {E} \ left [{\ frac {1} {kn}} \ sum _ {i = 1} ^ {n} x_ {i} \ right] = {\ frac {1} {kn}} \ sum _ {i = 1} ^ {n} \ mathbb {E} [x_ {i}].}

![{\ displaystyle \ mathbb {E} [{\ hat {\ theta}}] = \ mathbb {E} \ left [{\ frac {1} {kn}} \ sum _ {i = 1} ^ {n} x_ {i} \ right] = {\ frac {1} {kn}} \ sum _ {i = 1} ^ {n} \ mathbb {E} [x_ {i}].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7b17e7bf8b4676ee4d7967b301f3f8413b7b02a9)

Ne amintim {\ displaystyle \ mathbb {E} [x_ {i}] = k \ theta} ![{\ displaystyle \ mathbb {E} [x_ {i}] = k \ theta}](https://wikimedia.org/api/rest_v1/media/math/render/svg/3289a103aee025bd8c594d8e8b41596669d3405f)

- {\ displaystyle \ mathbb {E} [{\ hat {\ theta}}] = {\ frac {nk \ theta} {kn}} = \ theta.}

![{\ displaystyle \ mathbb {E} [{\ hat {\ theta}}] = {\ frac {nk \ theta} {kn}} = \ theta.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5f4f1a84738b0b7d1becb023f6bb6b9ecaa96c3c)

Estimator de dovadă a {\ displaystyle k}

Să analizăm acum calculul estimatorului pentru {\ displaystyle k}  .

.

Și aici funcția de probabilitate dispare pentru limita {\ displaystyle k \ rightarrow 0 ^ {+}}  Și {\ displaystyle k \ rightarrow + \ infty}

Și {\ displaystyle k \ rightarrow + \ infty}  , prin urmare, continuăm cu calculul derivatului.

, prin urmare, continuăm cu calculul derivatului.

- {\ displaystyle \ left ({\ frac {\ partial {\ mathcal {L}}} {\ partial k}} \ right) _ {k = {\ hat {k}}} \! \! \! \! \ ! = e ^ {- {\ frac {1} {\ theta}} \ sum x_ {i}} \ left (\ prod x_ {i} \ right) ^ {{\ hat {k}} - 1} \ left [{\ frac {\ ln \ left (\ prod x_ {i} \ right)} {\ theta ^ {n {\ hat {k}}} \ Gamma ^ {n} ({\ hat {k}})} } -n {\ frac {\ ln (\ theta) + \ psi _ {0} ({\ hat {k}})} {\ theta ^ {n {\ hat {k}}} \ Gamma ^ {n} ({\ hat {k}})}} \ right] = {\ frac {e ^ {- {\ frac {1} {\ theta}} \ sum x_ {i}} \ left (\ prod x_ {i} \ right) ^ {{\ hat {k}} - 1}} {\ theta ^ {n {\ hat {k}}} \ Gamma ^ {n} ({\ hat {k}})}} \ left [ \ ln \ left (\ prod {\ frac {x_ {i}} {\ theta}} \ right) -n \ psi _ {0} ({\ hat {k}}) \ right].}

![{\ displaystyle \ left ({\ frac {\ partial {\ mathcal {L}}} {\ partial k}} \ right) _ {k = {\ hat {k}}} \! \! \! \! \ ! = e ^ {- {\ frac {1} {\ theta}} \ sum x_ {i}} \ left (\ prod x_ {i} \ right) ^ {{\ hat {k}} - 1} \ left [{\ frac {\ ln \ left (\ prod x_ {i} \ right)} {\ theta ^ {n {\ hat {k}}} \ Gamma ^ {n} ({\ hat {k}})} } -n {\ frac {\ ln (\ theta) + \ psi _ {0} ({\ hat {k}})} {\ theta ^ {n {\ hat {k}}} \ Gamma ^ {n} ({\ hat {k}})}} \ right] = {\ frac {e ^ {- {\ frac {1} {\ theta}} \ sum x_ {i}} \ left (\ prod x_ {i} \ right) ^ {{\ hat {k}} - 1}} {\ theta ^ {n {\ hat {k}}} \ Gamma ^ {n} ({\ hat {k}})}} \ left [ \ ln \ left (\ prod {\ frac {x_ {i}} {\ theta}} \ right) -n \ psi _ {0} ({\ hat {k}}) \ right].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/2ddd482df97be2595f9ca0773936961a85e54341)

Cu {\ displaystyle \ psi _ {0} (k)}  indicăm funcția digamă astfel definită:

indicăm funcția digamă astfel definită:

- {\ displaystyle \ psi _ {0} (x): = {\ frac {\ Gamma '(x)} {\ Gamma (x)}} = {\ frac {d} {dx}} \ ln \ Gamma (x ),}

care poate fi exprimat printr-o relație integrală

- {\ displaystyle \ psi _ {0} (x) = \ int _ {0} ^ {\ infty} {\ frac {e ^ {- t} - (1 + t) ^ {- x}} {t}} dt.}

Echivalând funcția noastră de probabilitate cu zero, obținem punctul nostru maxim

- {\ displaystyle \ left ({\ frac {\ partial {\ mathcal {L}}} {\ partial k}} \ right) _ {k = {\ hat {k}}} \! \! \! \! \ ! = 0 \, \ Rightarrow \, \ ln \ left (\ prod {\ frac {x_ {i}} {\ theta}} \ right) -n \ psi _ {0} ({\ hat {k}}) = 0 \, \ Rightarrow \, \ psi _ {0} ({\ hat {k}}) = \ ln \ left ({\ sqrt [{n}] {\ prod {\ frac {x_ {i}} { \ theta}}}} \ right)}

![{\ displaystyle \ left ({\ frac {\ partial {\ mathcal {L}}} {\ partial k}} \ right) _ {k = {\ hat {k}}} \! \! \! \! \ ! = 0 \, \ Rightarrow \, \ ln \ left (\ prod {\ frac {x_ {i}} {\ theta}} \ right) -n \ psi _ {0} ({\ hat {k}}) = 0 \, \ Rightarrow \, \ psi _ {0} ({\ hat {k}}) = \ ln \ left ({\ sqrt [{n}] {\ prod {\ frac {x_ {i}} { \ theta}}}} \ right)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b3f390a9219c7dc1a3fab01b1535dd05814c3fb5)

Funcția digamă , în realuri pozitive, este strict în creștere, pentru care există funcția inversă

- {\ displaystyle {\ hat {k}} = \ psi _ {0} ^ {- 1} \ left [\ ln \ left ({\ sqrt [{n}] {\ prod _ {i = 1} ^ {n } {\ frac {x_ {i}} {\ theta}}}} \ right) \ right] = \ psi _ {0} ^ {- 1} \ left [{\ frac {1} {n}} \ sum _ {i = 1} ^ {n} \ ln \ left ({\ frac {x_ {i}} {\ theta}} \ right) \ right].}

![{\ displaystyle {\ hat {k}} = \ psi _ {0} ^ {- 1} \ left [\ ln \ left ({\ sqrt [{n}] {\ prod _ {i = 1} ^ {n } {\ frac {x_ {i}} {\ theta}}}} \ right) \ right] = \ psi _ {0} ^ {- 1} \ left [{\ frac {1} {n}} \ sum _ {i = 1} ^ {n} \ ln \ left ({\ frac {x_ {i}} {\ theta}} \ right) \ right].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/164a62cbd805287c5254b7a8ac721ae783ba8a40)

Acest estimator obținut este asimptotic corect , dar pentru valorile finite ar trebui să se verifice valoarea așteptată care, dacă se dovedește a fi {\ displaystyle k}  , atunci ar fi un estimator corect.

, atunci ar fi un estimator corect.

Calculăm apoi

- {\ displaystyle \ mathbb {E} [\ psi _ {0} ({\ hat {k}})] = \ mathbb {E} \ left [{\ frac {1} {n}} \ sum _ {i = 1} ^ {n} \ ln \ left ({\ frac {x_ {i}} {\ theta}} \ right) \ right] = {\ frac {1} {n}} \ sum _ {i = 1} ^ {n} \ mathbb {E} \ left [\ ln \ left ({\ frac {x_ {i}} {\ theta}} \ right) \ right] = {\ frac {1} {n}} \ sum _ {i = 1} ^ {n} \ int _ {0} ^ {\ infty} \ ln \ left ({\ frac {x_ {i}} {\ theta}} \ right) {\ frac {x_ {i } ^ {k-1}} {\ theta ^ {k} \ Gamma (k)}} e ^ {- {\ frac {x_ {i}} {\ theta}}} dx_ {i},}

![{\ displaystyle \ mathbb {E} [\ psi _ {0} ({\ hat {k}})] = \ mathbb {E} \ left [{\ frac {1} {n}} \ sum _ {i = 1} ^ {n} \ ln \ left ({\ frac {x_ {i}} {\ theta}} \ right) \ right] = {\ frac {1} {n}} \ sum _ {i = 1} ^ {n} \ mathbb {E} \ left [\ ln \ left ({\ frac {x_ {i}} {\ theta}} \ right) \ right] = {\ frac {1} {n}} \ sum _ {i = 1} ^ {n} \ int _ {0} ^ {\ infty} \ ln \ left ({\ frac {x_ {i}} {\ theta}} \ right) {\ frac {x_ {i } ^ {k-1}} {\ theta ^ {k} \ Gamma (k)}} e ^ {- {\ frac {x_ {i}} {\ theta}}} dx_ {i},}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0c8bc6cbbd89a2d13aaba1d276ae22c098b14765)

unde am folosit liniaritatea valorii așteptate și am scris definiția acesteia pe o variabilă continuă aleatorie.

- {\ displaystyle \ mathbb {E} [\ psi _ {0} ({\ hat {k}})] = {\ frac {1} {n \ theta ^ {k} \ Gamma (k)}} \ sum _ {i = 1} ^ {n} \ int _ {0} ^ {\ infty} \ ln \ left ({\ frac {x_ {i}} {\ theta}} \ right) x_ {i} ^ {k- 1} e ^ {- {\ frac {x_ {i}} {\ theta}}} dx_ {i} = {\ frac {1} {\ theta ^ {k} \ Gamma (k)}} \ int _ { 0} ^ {\ infty} \ ln \ left ({\ frac {t} {\ theta}} \ right) t ^ {k-1} e ^ {- {\ frac {t} {\ theta}}} dt }

![{\ displaystyle \ mathbb {E} [\ psi _ {0} ({\ hat {k}})] = {\ frac {1} {n \ theta ^ {k} \ Gamma (k)}} \ sum _ {i = 1} ^ {n} \ int _ {0} ^ {\ infty} \ ln \ left ({\ frac {x_ {i}} {\ theta}} \ right) x_ {i} ^ {k- 1} e ^ {- {\ frac {x_ {i}} {\ theta}}} dx_ {i} = {\ frac {1} {\ theta ^ {k} \ Gamma (k)}} \ int _ { 0} ^ {\ infty} \ ln \ left ({\ frac {t} {\ theta}} \ right) t ^ {k-1} e ^ {- {\ frac {t} {\ theta}}} dt }](https://wikimedia.org/api/rest_v1/media/math/render/svg/06d3bad1bfe68c7c540d2be4675258b12c5448f7)

Toate integralele din {\ displaystyle i}  -a variabilă este egală una cu cealaltă, deci suma lor dă {\ displaystyle n}

-a variabilă este egală una cu cealaltă, deci suma lor dă {\ displaystyle n}  de ori singura integrală din variabila de integrare generică {\ displaystyle t}

de ori singura integrală din variabila de integrare generică {\ displaystyle t}  .

.

- {\ displaystyle \ mathbb {E} [\ psi _ {0} ({\ hat {k}})] = {\ frac {1} {\ theta ^ {k} \ Gamma (k)}} \ int _ { 0} ^ {\ infty} \ ln \ left ({\ frac {t} {\ theta}} \ right) t ^ {k-1} e ^ {- {\ frac {t} {\ theta}}} dt = {\ frac {\ theta ^ {k-1}} {\ theta ^ {k-1} \ Gamma (k)}} \ int _ {0} ^ {\ infty} \ ln (u) u ^ {k -1} e ^ {- u} du = {\ frac {1} {\ Gamma (k)}} \ int _ {0} ^ {\ infty} u ^ {k-1} \ ln (u) e ^ {-u} du}

![{\ displaystyle \ mathbb {E} [\ psi _ {0} ({\ hat {k}})] = {\ frac {1} {\ theta ^ {k} \ Gamma (k)}} \ int _ { 0} ^ {\ infty} \ ln \ left ({\ frac {t} {\ theta}} \ right) t ^ {k-1} e ^ {- {\ frac {t} {\ theta}}} dt = {\ frac {\ theta ^ {k-1}} {\ theta ^ {k-1} \ Gamma (k)}} \ int _ {0} ^ {\ infty} \ ln (u) u ^ {k -1} e ^ {- u} du = {\ frac {1} {\ Gamma (k)}} \ int _ {0} ^ {\ infty} u ^ {k-1} \ ln (u) e ^ {-u} du}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cf449f93bd4efe7c443fa41cd0b6ffdd355b095f)

iar rezultatul acestei din urmă integrale este corect {\ displaystyle \ Gamma (k) \ psi _ {0} (k)}  pentru orice {\ displaystyle k}

pentru orice {\ displaystyle k}  cu partea reală pozitivă. Apoi am obținut identitatea

cu partea reală pozitivă. Apoi am obținut identitatea

- {\ displaystyle \ mathbb {E} [\ psi _ {0} ({\ hat {k}})] = \ psi _ {0} (k),}

![{\ displaystyle \ mathbb {E} [\ psi _ {0} ({\ hat {k}})] = \ psi _ {0} (k),}](https://wikimedia.org/api/rest_v1/media/math/render/svg/dbd20b00a6cac6593dc6497d5761c22f3ec4c0ba)

ceea ce nu este suficient pentru a spune că estimatorul este corect (nu numai asimptotic), dar este totuși necesar.

Într-adevăr din inegalitatea lui Jensen (conform căreia {\ displaystyle \ varphi (\ mathbb {E} [X]) \ leq \ mathbb {E} [\ varphi (X)]} ![{\ displaystyle \ varphi (\ mathbb {E} [X]) \ leq \ mathbb {E} [\ varphi (X)]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d34ce6476ae519e75fd57c640cb73cfd680b69c1) pentru orice variabilă aleatorie X și o funcție convexă {\ displaystyle \ varphi}

pentru orice variabilă aleatorie X și o funcție convexă {\ displaystyle \ varphi}  ) obțineți un rezultat mai puternic datorită faptului că funcția {\ displaystyle \ psi _ {0} ^ {- 1} \ colon \ mathbb {R} \ rightarrow \ mathbb {R} ^ {+}}

) obțineți un rezultat mai puternic datorită faptului că funcția {\ displaystyle \ psi _ {0} ^ {- 1} \ colon \ mathbb {R} \ rightarrow \ mathbb {R} ^ {+}}  este convex pe întregul său domeniu.

este convex pe întregul său domeniu.

De fapt folosind inegalitatea lui Jensen pentru {\ displaystyle X = \ psi _ {0} ({\ hat {k}})}  Și {\ displaystyle \ varphi = \ psi _ {0} ^ {- 1}}

Și {\ displaystyle \ varphi = \ psi _ {0} ^ {- 1}}  va rezulta

va rezulta

- {\ displaystyle \ psi _ {0} ^ {- 1} \ left (\ mathbb {E} \ left [\ psi _ {0} ({\ hat {k}}) \ right] \ right) \ leq \ mathbb {E} \ left [\ psi _ {0} ^ {- 1} \ left (\ psi _ {0} ({\ hat {k}}) \ right) \ right] = \ mathbb {E} [{\ pălărie {k}}].}

![{\ displaystyle \ psi _ {0} ^ {- 1} \ left (\ mathbb {E} \ left [\ psi _ {0} ({\ hat {k}}) \ right] \ right) \ leq \ mathbb {E} \ left [\ psi _ {0} ^ {- 1} \ left (\ psi _ {0} ({\ hat {k}}) \ right) \ right] = \ mathbb {E} [{\ pălărie {k}}].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c9a4911c2a2aba3bb77488949042223ca8daa58b)

Din egalitatea obținută mai sus, membrul din stânga se simplifică astfel încât să aibă:

- {\ displaystyle k \ leq \ mathbb {E} [{\ hat {k}}].}

![{\ displaystyle k \ leq \ mathbb {E} [{\ hat {k}}].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c026e53d32c0cca9e16d627b86c8848f71cbb6c8)

Elemente conexe

Alte proiecte

linkuri externe

(EN) Eric W. Weisstein, Distribuție în MathWorld Wolfram Research.

Wikimedia Commons conține imagini sau alte fișiere despre distribuția Gamma

Wikimedia Commons conține imagini sau alte fișiere despre distribuția Gamma

![{\ displaystyle \ mu _ {n} = \ mathbb {E} [X ^ {n}] = {\ tfrac {1} {\ theta ^ {k} \ Gamma (k)}} \ int _ {0} ^ {\ infty} x ^ {k + n-1} e ^ {- {\ frac {x} {\ theta}}} dx}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a8277ca0c5f22c9f11b60902d64458169995ac72)

![{\ displaystyle \ mathbb {E} [X] = k \ theta;}](https://wikimedia.org/api/rest_v1/media/math/render/svg/6cddf8c6de2a11a11f196f858b0f414cee055d86)

![{\ displaystyle \ mathbb {M} _ {X} (t) = \ mathbb {E} [e ^ {tX}] = {\ frac {1} {\ theta ^ {k} \ Gamma (k)}} \ int _ {0} ^ {\ infty} x ^ {k-1} e ^ {- x \ left ({\ frac {1} {\ theta}} - t \ right)} dx = {\ frac {1} {\ theta ^ {k} \ Gamma (k) ({\ tfrac {1} {\ theta}} - t) ^ {k}}} \ int _ {0} ^ {\ infty} u ^ {k-1 } și ^ {- u} du}](https://wikimedia.org/api/rest_v1/media/math/render/svg/229dbeb785cca82ca8dea2623c941173a8164f12)

![{\ displaystyle {\ hat {k}} = \ psi _ {0} ^ {- 1} \ left [\ ln \ left ({\ sqrt [{n}] {\ prod _ {i = 1} ^ {n } {\ frac {x_ {i}} {\ theta}}}} \ right) \ right] = \ psi _ {0} ^ {- 1} \ left [{\ frac {1} {n}} \ sum _ {i = 1} ^ {n} \ ln \ left ({\ frac {x_ {i}} {\ theta}} \ right) \ right].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/164a62cbd805287c5254b7a8ac721ae783ba8a40)

![{\ displaystyle \ mathbb {E} [{\ hat {\ theta}}] = \ mathbb {E} \ left [{\ frac {1} {kn}} \ sum _ {i = 1} ^ {n} x_ {i} \ right] = {\ frac {1} {kn}} \ sum _ {i = 1} ^ {n} \ mathbb {E} [x_ {i}].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7b17e7bf8b4676ee4d7967b301f3f8413b7b02a9)

![{\ displaystyle \ mathbb {E} [x_ {i}] = k \ theta}](https://wikimedia.org/api/rest_v1/media/math/render/svg/3289a103aee025bd8c594d8e8b41596669d3405f)

![{\ displaystyle \ mathbb {E} [{\ hat {\ theta}}] = {\ frac {nk \ theta} {kn}} = \ theta.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5f4f1a84738b0b7d1becb023f6bb6b9ecaa96c3c)

![{\ displaystyle \ left ({\ frac {\ partial {\ mathcal {L}}} {\ partial k}} \ right) _ {k = {\ hat {k}}} \! \! \! \! \ ! = e ^ {- {\ frac {1} {\ theta}} \ sum x_ {i}} \ left (\ prod x_ {i} \ right) ^ {{\ hat {k}} - 1} \ left [{\ frac {\ ln \ left (\ prod x_ {i} \ right)} {\ theta ^ {n {\ hat {k}}} \ Gamma ^ {n} ({\ hat {k}})} } -n {\ frac {\ ln (\ theta) + \ psi _ {0} ({\ hat {k}})} {\ theta ^ {n {\ hat {k}}} \ Gamma ^ {n} ({\ hat {k}})}} \ right] = {\ frac {e ^ {- {\ frac {1} {\ theta}} \ sum x_ {i}} \ left (\ prod x_ {i} \ right) ^ {{\ hat {k}} - 1}} {\ theta ^ {n {\ hat {k}}} \ Gamma ^ {n} ({\ hat {k}})}} \ left [ \ ln \ left (\ prod {\ frac {x_ {i}} {\ theta}} \ right) -n \ psi _ {0} ({\ hat {k}}) \ right].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/2ddd482df97be2595f9ca0773936961a85e54341)

![{\ displaystyle \ left ({\ frac {\ partial {\ mathcal {L}}} {\ partial k}} \ right) _ {k = {\ hat {k}}} \! \! \! \! \ ! = 0 \, \ Rightarrow \, \ ln \ left (\ prod {\ frac {x_ {i}} {\ theta}} \ right) -n \ psi _ {0} ({\ hat {k}}) = 0 \, \ Rightarrow \, \ psi _ {0} ({\ hat {k}}) = \ ln \ left ({\ sqrt [{n}] {\ prod {\ frac {x_ {i}} { \ theta}}}} \ right)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b3f390a9219c7dc1a3fab01b1535dd05814c3fb5)

![{\ displaystyle \ mathbb {E} [\ psi _ {0} ({\ hat {k}})] = \ mathbb {E} \ left [{\ frac {1} {n}} \ sum _ {i = 1} ^ {n} \ ln \ left ({\ frac {x_ {i}} {\ theta}} \ right) \ right] = {\ frac {1} {n}} \ sum _ {i = 1} ^ {n} \ mathbb {E} \ left [\ ln \ left ({\ frac {x_ {i}} {\ theta}} \ right) \ right] = {\ frac {1} {n}} \ sum _ {i = 1} ^ {n} \ int _ {0} ^ {\ infty} \ ln \ left ({\ frac {x_ {i}} {\ theta}} \ right) {\ frac {x_ {i } ^ {k-1}} {\ theta ^ {k} \ Gamma (k)}} e ^ {- {\ frac {x_ {i}} {\ theta}}} dx_ {i},}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0c8bc6cbbd89a2d13aaba1d276ae22c098b14765)

![{\ displaystyle \ mathbb {E} [\ psi _ {0} ({\ hat {k}})] = {\ frac {1} {n \ theta ^ {k} \ Gamma (k)}} \ sum _ {i = 1} ^ {n} \ int _ {0} ^ {\ infty} \ ln \ left ({\ frac {x_ {i}} {\ theta}} \ right) x_ {i} ^ {k- 1} e ^ {- {\ frac {x_ {i}} {\ theta}}} dx_ {i} = {\ frac {1} {\ theta ^ {k} \ Gamma (k)}} \ int _ { 0} ^ {\ infty} \ ln \ left ({\ frac {t} {\ theta}} \ right) t ^ {k-1} e ^ {- {\ frac {t} {\ theta}}} dt }](https://wikimedia.org/api/rest_v1/media/math/render/svg/06d3bad1bfe68c7c540d2be4675258b12c5448f7)

![{\ displaystyle \ mathbb {E} [\ psi _ {0} ({\ hat {k}})] = {\ frac {1} {\ theta ^ {k} \ Gamma (k)}} \ int _ { 0} ^ {\ infty} \ ln \ left ({\ frac {t} {\ theta}} \ right) t ^ {k-1} e ^ {- {\ frac {t} {\ theta}}} dt = {\ frac {\ theta ^ {k-1}} {\ theta ^ {k-1} \ Gamma (k)}} \ int _ {0} ^ {\ infty} \ ln (u) u ^ {k -1} e ^ {- u} du = {\ frac {1} {\ Gamma (k)}} \ int _ {0} ^ {\ infty} u ^ {k-1} \ ln (u) e ^ {-u} du}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cf449f93bd4efe7c443fa41cd0b6ffdd355b095f)

![{\ displaystyle \ mathbb {E} [\ psi _ {0} ({\ hat {k}})] = \ psi _ {0} (k),}](https://wikimedia.org/api/rest_v1/media/math/render/svg/dbd20b00a6cac6593dc6497d5761c22f3ec4c0ba)

![{\ displaystyle \ varphi (\ mathbb {E} [X]) \ leq \ mathbb {E} [\ varphi (X)]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d34ce6476ae519e75fd57c640cb73cfd680b69c1)

![{\ displaystyle \ psi _ {0} ^ {- 1} \ left (\ mathbb {E} \ left [\ psi _ {0} ({\ hat {k}}) \ right] \ right) \ leq \ mathbb {E} \ left [\ psi _ {0} ^ {- 1} \ left (\ psi _ {0} ({\ hat {k}}) \ right) \ right] = \ mathbb {E} [{\ pălărie {k}}].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c9a4911c2a2aba3bb77488949042223ca8daa58b)

![{\ displaystyle k \ leq \ mathbb {E} [{\ hat {k}}].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c026e53d32c0cca9e16d627b86c8848f71cbb6c8)