În teoria probabilității distribuția lui Student , sau t-ul lui Student , este o distribuție continuă a probabilității care guvernează relația dintre două variabile aleatorii , prima cu o distribuție normală și a doua, pătrată, urmând o distribuție chi-pătrată .

Această distribuție intervine în estimarea mediei unei populații care urmează distribuției normale și este utilizată în testul t al Studentului omonim pentru semnificație și pentru fiecare interval de încredere al diferenței dintre două medii .

fundal

Distribuția a fost descrisă în 1908 de William Sealy Gosset , care și-a publicat rezultatul sub pseudonimul „Student” deoarece fabrica de bere Guinness unde era angajat interzicea angajaților săi să publice articole, astfel încât să nu divulge secretele producției. Numele distribuției studentului a fost introdus ulterior de Ronald Fisher . [2] [3]

Definiție

Distribuția Student cu parametru {\ displaystyle n}  ( grade de libertate ) guvernează variabila aleatorie

( grade de libertate ) guvernează variabila aleatorie

- {\ displaystyle t_ {n} = {\ frac {Z} {\ sqrt {k / n}}}}

unde este {\ displaystyle Z}  Și {\ displaystyle k}

Și {\ displaystyle k}  sunt două variabile aleatoare independente care respectă distribuția normală standard {\ displaystyle {\ mathcal {N}} (0,1)}

sunt două variabile aleatoare independente care respectă distribuția normală standard {\ displaystyle {\ mathcal {N}} (0,1)}  și distribuția chi-pătrat {\ displaystyle \ chi ^ {2} (n)}

și distribuția chi-pătrat {\ displaystyle \ chi ^ {2} (n)}  cu {\ displaystyle n}

cu {\ displaystyle n}  grade de libertate.

grade de libertate.

Estimatori

Media {\ displaystyle \ mu}  și varianța {\ displaystyle \ sigma ^ {2}}

și varianța {\ displaystyle \ sigma ^ {2}}  a unei populații {\ displaystyle X}

a unei populații {\ displaystyle X}  poate fi estimat printr-un eșantion de {\ displaystyle N}

poate fi estimat printr-un eșantion de {\ displaystyle N}  elemente, {\ displaystyle X_ {1}, \ ldots, X_ {N}}

elemente, {\ displaystyle X_ {1}, \ ldots, X_ {N}}  cu estimatori

cu estimatori

- {\ displaystyle {\ bar {X}} = {\ frac {1} {N}} \ sum _ {i = 1} ^ {N} X_ {i}}

- {\ displaystyle S ^ {2} = {\ frac {1} {N-1}} \ sum _ {i = 1} ^ {N} (X_ {i} - {\ bar {X}}) ^ {2 }.}

Să presupunem variabilele aleatorii {\ displaystyle X_ {1}, \ ldots, X_ {N}}  care alcătuiesc eșantionul sunt independente și distribuite în mod normal , atunci {\ displaystyle {\ bar {X}}}

care alcătuiesc eșantionul sunt independente și distribuite în mod normal , atunci {\ displaystyle {\ bar {X}}}  este o variabilă normală {\ displaystyle {\ mathcal {N}} \ left (\ mu, {\ frac {\ sigma ^ {2}} {N}} \ right)}

este o variabilă normală {\ displaystyle {\ mathcal {N}} \ left (\ mu, {\ frac {\ sigma ^ {2}} {N}} \ right)}  cu valoarea așteptată {\ displaystyle \ mu}

cu valoarea așteptată {\ displaystyle \ mu}  și varianță{\ displaystyle {\ frac {\ sigma ^ {2}} {N}}}

și varianță{\ displaystyle {\ frac {\ sigma ^ {2}} {N}}}  . Prin urmare variabila {\ displaystyle Z}

. Prin urmare variabila {\ displaystyle Z}  atât de definit

atât de definit

- {\ displaystyle Z = {\ frac {{\ bar {X}} - \ mu} {\ sqrt {\ sigma ^ {2} / N}}}}

va urma o distribuție normală standard, {\ displaystyle {\ mathcal {N}} (0,1)}  . Problema este că adesea nu se știe {\ displaystyle \ sigma ^ {2}}

. Problema este că adesea nu se știe {\ displaystyle \ sigma ^ {2}}  , prin urmare va trebui să avem de-a face cu un estimator al varianței cum ar fi {\ displaystyle S ^ {2}}

, prin urmare va trebui să avem de-a face cu un estimator al varianței cum ar fi {\ displaystyle S ^ {2}}  .

.

Vom demonstra că următoarea variabilă aleatorie

- {\ displaystyle k = {\ frac {(N-1) S ^ {2}} {\ sigma ^ {2}}}}

urmează o distribuție chi-pătrat cu {\ displaystyle N-1}  grade de libertate, {\ displaystyle \ chi _ {(N-1)} ^ {2}}

grade de libertate, {\ displaystyle \ chi _ {(N-1)} ^ {2}}  .

.

Cele două variabile aleatorii {\ displaystyle Z}  Și {\ displaystyle k}

Și {\ displaystyle k}  sunt independenți , conform teoremei lui Cochran .

sunt independenți , conform teoremei lui Cochran .

Prin urmare, variabila aleatorie este definită

- {\ displaystyle t_ {N-1} = {\ frac {{\ bar {X}} - \ mu} {\ sqrt {S ^ {2} / N}}} = {\ frac {{\ bar {X} } - \ mu} {\ sqrt {{\ frac {\ sigma ^ {2}} {N}} {\ frac {(N-1) S ^ {2}} {(N-1) \ sigma ^ {2 }}}}}} = {\ frac {Z} {\ sqrt {k / (N-1)}}}}

Această variabilă aleatorie urmează o distribuție de probabilitate numită "Student's t".

Găsiți distribuția t

Să începem prin a demonstra asta {\ displaystyle k}  este o variabilă aleatorie chi-pătrat. Reamintim că o distribuție {\ displaystyle \ chi ^ {2} (n)}

este o variabilă aleatorie chi-pătrat. Reamintim că o distribuție {\ displaystyle \ chi ^ {2} (n)}  este o anumită variabilă gamma definită după cum urmează

este o anumită variabilă gamma definită după cum urmează

- {\ displaystyle \ chi ^ {2} (n) = \ mathrm {\ Gamma} \ left ({\ frac {1} {2}}, {\ frac {n} {2}} \ right) = {\ frac {e ^ {- {\ frac {x} {2}}} x ^ {{\ frac {n} {2}} - 1}} {2 ^ {\ frac {n} {2}} \ Gamma ({ \ frac {n} {2}})}}.}

Unde este {\ displaystyle \ Gamma (x)}  este funcția Euler Gamma definită ca {\ displaystyle \ Gamma (x) = \ int _ {0} ^ {+ \ infty} {t ^ {x-1} e ^ {- t} dt}}

este funcția Euler Gamma definită ca {\ displaystyle \ Gamma (x) = \ int _ {0} ^ {+ \ infty} {t ^ {x-1} e ^ {- t} dt}}  cu {\ displaystyle Re (x) \ neq -n, \ forall n \ in \ mathbb {N} _ {0}}

cu {\ displaystyle Re (x) \ neq -n, \ forall n \ in \ mathbb {N} _ {0}}

O variabilă chi-pătrat cu {\ displaystyle n}  grade de libertate se obține prin adăugare {\ displaystyle n}

grade de libertate se obține prin adăugare {\ displaystyle n}  variabile normale standard {\ displaystyle {\ mathcal {N}} (0,1)}

variabile normale standard {\ displaystyle {\ mathcal {N}} (0,1)}  pătrat. Acestea fiind spuse, să începem cu definiția varianței eșantionului și să adunăm și să scădem în argumentul însumării {\ displaystyle \ mu}

pătrat. Acestea fiind spuse, să începem cu definiția varianței eșantionului și să adunăm și să scădem în argumentul însumării {\ displaystyle \ mu}  , valoarea așteptată a variabilei aleatorii {\ displaystyle X_ {i}}

, valoarea așteptată a variabilei aleatorii {\ displaystyle X_ {i}}  care coincide cu cea a variabilei aleatorii {\ displaystyle {\ bar {X}}}

care coincide cu cea a variabilei aleatorii {\ displaystyle {\ bar {X}}}  .

.

- {\ displaystyle S ^ {2} = {\ frac {1} {N-1}} \ sum _ {i} (X_ {i} - {\ bar {X}}) ^ {2} = {\ frac { 1} {N-1}} \ sum _ {i} (X_ {i} + \ mu - \ mu - {\ bar {X}}) ^ {2}.}

Să definim parametrii {\ displaystyle a}  Și {\ displaystyle b}

Și {\ displaystyle b}  ca {\ displaystyle a = X_ {i} - \ mu, b = {\ bar {X}} - \ mu}

ca {\ displaystyle a = X_ {i} - \ mu, b = {\ bar {X}} - \ mu}  și rescrieți formula anterioară

și rescrieți formula anterioară

- {\ displaystyle (N-1) S ^ {2} = \ sum _ {i} (ab) ^ {2} = \ sum _ {i} a ^ {2} + \ sum _ {i} b ^ {2 } -2 \ sum _ {i} ab = \ sum _ {i} (X_ {i} - \ mu) ^ {2} + \ sum _ {i} ({\ bar {X}} - \ mu) ^ {2} -2 \ sum _ {i} ({\ bar {X}} - \ mu) (X_ {i} - \ mu).}

Acum putem explica explicit din rezumări toți termenii care nu depind de {\ displaystyle i}  , adică {\ displaystyle {\ bar {X}}}

, adică {\ displaystyle {\ bar {X}}}  Și {\ displaystyle \ mu}

Și {\ displaystyle \ mu}

- {\ displaystyle (N-1) S ^ {2} = \ sum _ {i} (X_ {i} - \ mu) ^ {2} + N ({\ bar {X}} - \ mu) ^ {2 } -2 ({\ bar {X}} - \ mu) \ sum _ {i} (X_ {i} - \ mu) = \ sum _ {i} (X_ {i} - \ mu) ^ {2} + N ({\ bar {X}} - \ mu) ^ {2} -2 ({\ bar {X}} - \ mu) \ left [-N \ mu + \ sum _ {i} X_ {i} \ dreapta]}

![{\ displaystyle (N-1) S ^ {2} = \ sum _ {i} (X_ {i} - \ mu) ^ {2} + N ({\ bar {X}} - \ mu) ^ {2 } -2 ({\ bar {X}} - \ mu) \ sum _ {i} (X_ {i} - \ mu) = \ sum _ {i} (X_ {i} - \ mu) ^ {2} + N ({\ bar {X}} - \ mu) ^ {2} -2 ({\ bar {X}} - \ mu) \ left [-N \ mu + \ sum _ {i} X_ {i} \ dreapta]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cd62d94edd82ec0b11ead231f41fc6938fde2251)

- {\ displaystyle (N-1) S ^ {2} = \ sum _ {i} (X_ {i} - \ mu) ^ {2} + N ({\ bar {X}} - \ mu) ^ {2 } -2N ({\ bar {X}} - \ mu) ^ {2} = \ sum _ {i} (X_ {i} - \ mu) ^ {2} -N ({\ bar {X}} - \ mu) ^ {2},}

știind că suma pe toate {\ displaystyle X_ {i}}  este egal cu {\ displaystyle N {\ bar {X}}}

este egal cu {\ displaystyle N {\ bar {X}}}  . Acum împărțind stânga și dreapta la {\ displaystyle \ sigma ^ {2}}

. Acum împărțind stânga și dreapta la {\ displaystyle \ sigma ^ {2}}  ajungem în dreapta variabilelor normale

ajungem în dreapta variabilelor normale

- {\ displaystyle {\ frac {(N-1) S ^ {2}} {\ sigma ^ {2}}} = \ sum _ {i} ^ {N} \ left ({\ frac {X_ {i} - \ mu} {\ sigma}} \ right) ^ {2} -N \ left ({\ frac {{\ bar {X}} - \ mu} {\ sigma}} \ right) ^ {2} = \ sum _ {i} ^ {N} \ left ({\ frac {X_ {i} - \ mu} {\ sigma}} \ right) ^ {2} - \ left ({\ frac {{\ bar {X}} - \ mu} {\ sigma / {\ sqrt {N}}}} \ right) ^ {2}.}

Prin urmare, am obținut în stânga o variabilă cu care am indicat anterior {\ displaystyle k}  , în timp ce în dreapta avem sume ale variabilelor normale standard pătrate, care coincid cu o variabilă chi la pătrat cu {\ displaystyle N}

, în timp ce în dreapta avem sume ale variabilelor normale standard pătrate, care coincid cu o variabilă chi la pătrat cu {\ displaystyle N}  grade de libertate și o altă variabilă normală, de asemenea, pătrată standard, adică o variabilă chi-pătrat cu un singur grad de libertate. Știind că sume de variabile chi-pătrate cu {\ displaystyle n}

grade de libertate și o altă variabilă normală, de asemenea, pătrată standard, adică o variabilă chi-pătrat cu un singur grad de libertate. Știind că sume de variabile chi-pătrate cu {\ displaystyle n}  Și {\ displaystyle m}

Și {\ displaystyle m}  grade de libertate încă corespund unei variabile chi-pătrat cu {\ displaystyle n + m}

grade de libertate încă corespund unei variabile chi-pătrat cu {\ displaystyle n + m}  grade de libertate obținem că funcția densității probabilității de {\ displaystyle k}

grade de libertate obținem că funcția densității probabilității de {\ displaystyle k}  este chi-pătrat cu {\ displaystyle N-1}

este chi-pătrat cu {\ displaystyle N-1}  grade de libertate.

grade de libertate.

Prin urmare, acum să începem să spunem asta

- {\ displaystyle t_ {n} | k = Z {\ sqrt {\ frac {n} {k}}}}

unde este {\ displaystyle n = N-1}  este numărul de grade de libertate și asta

este numărul de grade de libertate și asta

- {\ displaystyle f (t_ {n} | k) = {\ mathcal {N}} \ left (0, {\ frac {n} {k}} \ right) = {\ sqrt {\ frac {k} {2 \ pi n}}} și ^ {- {\ frac {kt ^ {2}} {2n}}}.}

Cunoscută variabila aleatorie {\ displaystyle k}  , de fapt, este redus la un parametru multiplicativ pentru normal. Din definiția probabilității condiționale pe care o avem

, de fapt, este redus la un parametru multiplicativ pentru normal. Din definiția probabilității condiționale pe care o avem

- {\ displaystyle f (t_ {n}, k) = f (t_ {n} | k) f (k),}

unde este

- {\ displaystyle f (k) = {\ frac {e ^ {- {\ frac {k} {2}}} k ^ {{\ frac {n} {2}} - 1}} {2 ^ {\ frac {n} {2}} \ Gamma \ left ({\ frac {n} {2}} \ right)}},}

este o distribuție chi-pătrat cu {\ displaystyle n = N-1}  grade de libertate. Prin urmare

grade de libertate. Prin urmare

- {\ displaystyle f (t_ {n}, k) = {\ sqrt {\ frac {k} {2 \ pi n}}} e ^ {- {\ frac {kt ^ {2}} {2n}}} { \ frac {e ^ {- {\ frac {k} {2}}} k ^ {{\ frac {n} {2}} - 1}} {2 ^ {\ frac {n} {2}} \ Gamma \ left ({\ frac {n} {2}} \ right)}} = {\ frac {k ^ {\ frac {n-1} {2}} e ^ {- {\ frac {k} {2} } \ left (1 + {\ frac {t ^ {2}} {n}} \ right)}} {2 ^ {\ frac {n + 1} {2}} {\ sqrt {\ pi n}} \ Interval \ left ({\ frac {n} {2}} \ right)}}.}

Observăm că funcția de distribuție dorită nu este altceva decât o funcție marginală a {\ displaystyle f (t_ {n}, k)}  , de aceea avem

, de aceea avem

- {\ displaystyle f (t_ {n}) = \ int _ {0} ^ {\ infty} \! \! \! f (t_ {n}, k) dk}

- {\ displaystyle f (t_ {n}) = {\ frac {1} {2 ^ {\ frac {n + 1} {2}} {\ sqrt {\ pi n}} \ Gamma \ left ({\ frac { n} {2}} \ right)}} \ int _ {0} ^ {+ \ infty} k ^ {\ frac {n-1} {2}} e ^ {- {\ frac {k} {2} } \ left (1 + {\ frac {t ^ {2}} {n}} \ right)} dk.}

Plasând o substituție cu argumentul exponențial, dar menținându-l negativ

- {\ displaystyle y = {\ frac {k} {2}} \ left (1 + {\ frac {t ^ {2}} {n}} \ right), dk = 2 \ left (1 + {\ frac { t ^ {2}} {n}} \ right) ^ {- 1} dy,}

noi obținem

- {\ displaystyle f (t_ {n}) = {\ frac {\ left (1 + {\ frac {t ^ {2}} {n}} \ right) ^ {- 1}} {2 ^ {\ frac { n-1} {2}} {\ sqrt {\ pi n}} \ Gamma ({\ frac {n} {2}})}} \ int _ {0} ^ {+ \ infty} \ left ({\ frac {2y} {1 + {\ frac {t ^ {2}} {n}}}} \ right) ^ {\ frac {n-1} {2}} e ^ {- y} dy = {\ frac {\ left (1 + {\ frac {t ^ {2}} {n}} \ right) ^ {- {\ frac {n + 1} {2}}}} {{\ sqrt {\ pi n}} \ Gamma \ left ({\ frac {n} {2}} \ right)}} \ int _ {0} ^ {+ \ infty} y ^ {\ frac {n-1} {2}} e ^ {- y} dy,}

integralul definit are ca rezultat funcția Euler Gamma în sine

- {\ displaystyle \ int _ {0} ^ {+ \ infty} y ^ {\ frac {n-1} {2}} e ^ {- y} dy = \ Gamma \ left ({\ frac {n-1} {2}} + 1 \ right) = \ Gamma \ left ({\ frac {n + 1} {2}} \ right)}

Prin urmare, obținem rezultatul nostru în cele din urmă

- {\ displaystyle f (t_ {n}) = {\ frac {\ Gamma \ left ({\ frac {n + 1} {2}} \ right)} {{\ sqrt {\ pi n}} \ Gamma \ left ({\ frac {n} {2}} \ right)}} \ cdot \ left (1 + {\ frac {t ^ {2}} {n}} \ right) ^ {- {\ frac {n + 1 } {2}}}}

Observăm că limita acestei secvențe de funcții este pentru {\ displaystyle n \ rightarrow \ infty}  Și

Și

- {\ displaystyle \ lim _ {n \ to \ infty} f (t_ {n}) = {\ frac {1} {\ sqrt {\ pi}}} \ lim _ {n \ to \ infty} {\ frac { \ Gamma \ left ({\ frac {n + 1} {2}} \ right)} {{\ sqrt {n}} \ Gamma \ left ({\ frac {n} {2}} \ right)}} \ lim _ {n \ to \ infty} \ left (1 + {\ frac {t ^ {2}} {n}} \ right) ^ {- {\ frac {n + 1} {2}}} = {\ frac {1} {\ sqrt {2 \ pi}}} și ^ {- {\ frac {t ^ {2}} {2}}}.}

Știind că prima limită are ca rezultat {\ displaystyle {\ frac {1} {\ sqrt {2}}}}  iar al doilea tinde să {\ displaystyle e ^ {- {\ frac {t ^ {2}} {2}}}}

iar al doilea tinde să {\ displaystyle e ^ {- {\ frac {t ^ {2}} {2}}}}  .

.

În practică, luând o populație mare {\ displaystyle N}  foarte mare, variabila aleatorie t tinde să fie un standard normal.

foarte mare, variabila aleatorie t tinde să fie un standard normal.

Caracteristici

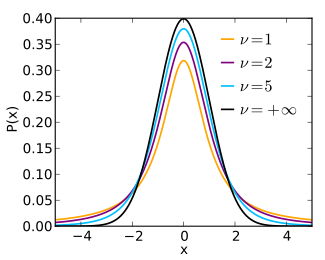

Distribuția elevului cu {\ displaystyle n}  gradele de libertate sunt simetrice , deoarece distribuția normală standard este, în timp ce distribuția chi-pătrat care acționează ca un „parametru aleatoriu la scară” nu produce efecte de distorsiune ale acestei simetrii.

gradele de libertate sunt simetrice , deoarece distribuția normală standard este, în timp ce distribuția chi-pătrat care acționează ca un „parametru aleatoriu la scară” nu produce efecte de distorsiune ale acestei simetrii.

Funcția sa de densitate a probabilității este

- {\ displaystyle f (t) = {\ frac {\ Gamma \ left ({\ frac {n + 1} {2}} \ right)} {{\ sqrt {n \ pi}} \ Gamma \ left ({\ frac {n} {2}} \ right)}} \ left (1 + {\ frac {t ^ {2}} {n}} \ right) ^ {- (n + 1) / 2} = {\ frac {1} {{\ sqrt {n}} \, \ mathrm {B} \ left ({\ frac {1} {2}}, {\ frac {n} {2}} \ right)}} \ left ( 1 + {\ frac {t ^ {2}} {n}} \ right) ^ {- (n + 1) / 2}}

,

,

unde este {\ displaystyle \ mathrm {B}}  funcția beta .

funcția beta .

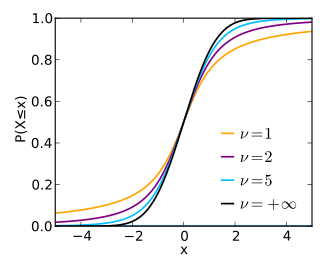

Funcția sa de distribuție este

- {\ displaystyle F (t) = I_ {x} \ left ({\ frac {n} {2}}, {\ frac {n} {2}} \ right)}

unde este {\ displaystyle I_ {x} (a, b) = {\ frac {\ mathrm {B} (x, a, b)} {\ mathrm {B} (a, b)}}}  este funcția beta incompletă regularizată cu

este funcția beta incompletă regularizată cu

- {\ displaystyle x = {\ frac {t + {\ sqrt {t ^ {2} + n}}} {2 {\ sqrt {t ^ {2} + n}}}}}

Pentru {\ displaystyle k <n}  momentele (simple sau centrale, deoarece coincid pentru un pdf simetric) de ordine {\ displaystyle k}

momentele (simple sau centrale, deoarece coincid pentru un pdf simetric) de ordine {\ displaystyle k}  de distribuție sunt

de distribuție sunt

- {\ displaystyle \ mu _ {k} = 0}

de sine {\ displaystyle k}

de sine {\ displaystyle k}  e ciudat,

e ciudat, - {\ displaystyle \ mu _ {k} = {\ frac {\ Gamma ({\ frac {k + 1} {2}}) \ Gamma ({\ frac {nk} {2}}) n ^ {k / 2 }} {{\ sqrt {\ pi}} \ Gamma ({\ frac {n} {2}})}}}

de sine {\ displaystyle k}

de sine {\ displaystyle k}  este chiar.

este chiar.

În special, pe lângă speranța matematică {\ displaystyle E (t) = 0}  și indicele de asimetrie{\ displaystyle \ gamma _ {1} = 0}

și indicele de asimetrie{\ displaystyle \ gamma _ {1} = 0}  (pentru {\ displaystyle n> 3}

(pentru {\ displaystyle n> 3}  ) prezis de simetria distribuției, găsim:

) prezis de simetria distribuției, găsim:

- varianța {\ displaystyle {\ text {Var}} (t) = {\ frac {n} {n-2}}}

pentru {\ displaystyle n> 2}

pentru {\ displaystyle n> 2}

- indicele kurtosis {\ displaystyle \ gamma _ {2} = {\ frac {6} {n-4}}}

pentru {\ displaystyle n> 4}

pentru {\ displaystyle n> 4}

În cele din urmă, să luăm în considerare un ultim parametru, FWHM , care este lățimea la jumătatea înălțimii. Pentru o variabilă {\ displaystyle t}  de Student avem că vârful funcției este în valoarea sa așteptată, adică în, în care distribuția are valoare maximă {\ displaystyle {\ frac {\ Gamma ({\ frac {n + 1} {2}})} {{\ sqrt {\ pi n}} \ Gamma ({\ frac {n} {2}})}} }

de Student avem că vârful funcției este în valoarea sa așteptată, adică în, în care distribuția are valoare maximă {\ displaystyle {\ frac {\ Gamma ({\ frac {n + 1} {2}})} {{\ sqrt {\ pi n}} \ Gamma ({\ frac {n} {2}})}} }  . Deci găsim valorile {\ displaystyle t}

. Deci găsim valorile {\ displaystyle t}  pentru care {\ displaystyle f (t_ {n})}

pentru care {\ displaystyle f (t_ {n})}  presupune înălțime egală cu jumătate din maximul absolut.

presupune înălțime egală cu jumătate din maximul absolut.

{\ displaystyle {\ frac {\ Gamma ({\ frac {n + 1} {2}})} {2 {\ sqrt {\ pi n}} \ Gamma ({\ frac {n} {2}})} } = {\ frac {\ Gamma ({\ frac {n + 1} {2}}) \ left (1 + {\ frac {t ^ {2}} {n}} \ right) ^ {- {\ frac {n + 1} {2}}}} {{\ sqrt {\ pi n}} \ Gamma ({\ frac {n} {2}})}}

Pentru care

{\ textstyle {\ frac {1} {2}} = (1 + {\ frac {t ^ {2}} {n}}) ^ {- {\ frac {n + 1} {2}}}}  care echivalează cu {\ textstyle 2 = (1 + {\ frac {t ^ {2}} {n}}) ^ {\ frac {n + 1} {2}}}

care echivalează cu {\ textstyle 2 = (1 + {\ frac {t ^ {2}} {n}}) ^ {\ frac {n + 1} {2}}}  unde este {\ displaystyle t}

unde este {\ displaystyle t}  are două soluții, așa cum ne-am așteptat de la simetria funcției, coincizând a

are două soluții, așa cum ne-am așteptat de la simetria funcției, coincizând a

{\ displaystyle t _ {\ pm} = \ pm {\ sqrt {n \ left (2 ^ {\ frac {2} {n + 1}} - 1 \ right)}}}

Deci lățimea la jumătate de înălțime a funcției este dată de {\ displaystyle t _ {+} - t _ {-} = 2 {\ sqrt {n \ left (2 ^ {\ frac {2} {n + 1}} - 1 \ right)}}}

Rularea limitei pentru {\ displaystyle n \ rightarrow \ infty}  găsim o expresie convergentă a

găsim o expresie convergentă a

{\ displaystyle \ lim _ {n \ to \ infty} t _ {+} - t _ {-} = 2 {\ sqrt {ln4}} = {\ sqrt {8ln2}}}

care este echivalentul FWHM al standardului normal. Viceversa pt {\ displaystyle n = 1}  obținem un FWHM = 2. De fapt pentru {\ displaystyle n = 1}

obținem un FWHM = 2. De fapt pentru {\ displaystyle n = 1}  distribuția Student t coincide cu o distribuție a parametrilor Lorentz-Cauchy {\ displaystyle (0,1)}

distribuția Student t coincide cu o distribuție a parametrilor Lorentz-Cauchy {\ displaystyle (0,1)}  unde FWHM este exact egal cu {\ displaystyle 2}

unde FWHM este exact egal cu {\ displaystyle 2}  .

.

Statistici

Interval de încredere

Distribuția Student este utilizată pentru a defini intervalele de încredere pentru media unei populații, pe baza estimatorilor de puncte {\ displaystyle {\ bar {X}}}  Și {\ displaystyle S_ {n} ^ {2}}

Și {\ displaystyle S_ {n} ^ {2}}  media și varianța acestuia. Din ecuație

media și varianța acestuia. Din ecuație

- {\ displaystyle T = {\ frac {{\ bar {X}} - \ mu} {\ sqrt {S_ {n} ^ {2} / n}}}}

intr-adevar

- {\ displaystyle P (a \ leqslant T \ leqslant b) = P \ left ({\ bar {X}} - b {\ sqrt {S_ {n} ^ {2} / n}} \ leqslant \ mu \ leqslant { \ bar {X}} - a {\ sqrt {S_ {n} ^ {2} / n}} \ right)}

.

.

Prin urmare, alegerea cuantilelor {\ displaystyle q _ {\ alpha} <q _ {\ beta}}  pentru distribuirea elevilor cu {\ displaystyle n}

pentru distribuirea elevilor cu {\ displaystyle n}  grade de libertate, da

grade de libertate, da

- {\ displaystyle \ beta - \ alpha = P (q _ {\ alpha} \ leqslant T \ leqslant q _ {\ beta}) = P \ left ({\ bar {X}} - q _ {\ beta} {\ sqrt {S_ {n} ^ {2} / n}} \ leqslant \ mu \ leqslant {\ bar {X}} - q _ {\ alpha} {\ sqrt {S_ {n} ^ {2} / n}} \ dreapta)}

,

,

adică un interval de încredere pentru medie {\ displaystyle \ mu}  cu nivel de încredere {\ displaystyle \ beta - \ alpha}

cu nivel de încredere {\ displaystyle \ beta - \ alpha}  Și:

Și:

- {\ displaystyle \ left [\ {\ bar {X}} - q _ {\ beta} {\ sqrt {S_ {n} ^ {2} / n}} \, \ {\ bar {X}} - q _ {\ alpha} {\ sqrt {S_ {n} ^ {2} / n}} \ \ right]}

![{\ displaystyle \ left [\ {\ bar {X}} - q _ {\ beta} {\ sqrt {S_ {n} ^ {2} / n}} \, \ {\ bar {X}} - q _ {\ alpha} {\ sqrt {S_ {n} ^ {2} / n}} \ \ right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ad437676d3defad2cdb4d7fb9005965248d37ce5) .

.

Dacă sunt luate în considerare intervale simetrice, se poate utiliza indicele {\ displaystyle z _ {\ alpha}}  definit de

definit de

- {\ displaystyle \ alpha = P (| T | \ leqslant z _ {\ alpha}) = P (-z _ {\ alpha} \ leqslant T \ leqslant z _ {\ alpha}) = 2F (z _ {\ alpha }) - 1}

,

,

adică

- {\ displaystyle z _ {\ alpha} = q_ {1 - {\ frac {\ alpha} {2}}}}

,

,

și obținem intervalul de încredere pentru {\ displaystyle \ mu}  cu nivel de încredere {\ displaystyle \ alpha}

cu nivel de încredere {\ displaystyle \ alpha}

- {\ displaystyle \ left [\ {\ bar {X}} - z _ {\ alpha} {\ sqrt {S_ {n} ^ {2} / n}} \, \ {\ bar {X}} + z _ {\ alpha} {\ sqrt {S_ {n} ^ {2} / n}} \ \ right]}

![{\ displaystyle \ left [\ {\ bar {X}} - z _ {\ alpha} {\ sqrt {S_ {n} ^ {2} / n}} \, \ {\ bar {X}} + z _ {\ alpha} {\ sqrt {S_ {n} ^ {2} / n}} \ \ right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/262da260be336a9680367d4e51aeec6c90267d66) .

.

Alte distribuții

Distribuția Student cu parametru {\ displaystyle n = 1}  corespunde distribuției Cauchy a parametrilor {\ displaystyle (0,1)}

corespunde distribuției Cauchy a parametrilor {\ displaystyle (0,1)}  : ambele reglează raportul {\ displaystyle X / Y}

: ambele reglează raportul {\ displaystyle X / Y}  între două variabile aleatoare independente cu distribuție normală standard.

între două variabile aleatoare independente cu distribuție normală standard.

Deoarece n tinde spre infinit, distribuția Student cu n grade de libertate converge la distribuția normală standard {\ displaystyle {\ mathcal {N}} (0,1)}  .

.

De sine {\ displaystyle T}  este o variabilă aleatorie cu distribuția t Student ca parametru {\ displaystyle n}

este o variabilă aleatorie cu distribuția t Student ca parametru {\ displaystyle n}  , asa de {\ displaystyle F = T ^ {2}}

, asa de {\ displaystyle F = T ^ {2}}  urmează distribuția parametrilor Fisher-Snedecor {\ displaystyle (1, n)}

urmează distribuția parametrilor Fisher-Snedecor {\ displaystyle (1, n)}  .

.

Masa cuantilă

Următorul tabel [4] exprimă, în funcție de parametrul n (rând) și valorile particulare ale {\ displaystyle \ alpha}  (coloană), cuantilele {\ displaystyle q _ {\ alpha}}

(coloană), cuantilele {\ displaystyle q _ {\ alpha}}  pentru distribuția Student a parametrului n :

pentru distribuția Student a parametrului n :

- {\ displaystyle P (T \ leqslant q _ {\ alpha}) = F (q _ {\ alpha}) = \ alpha}

.

.

Ultima linie, notată cu „∞”, se referă la o distribuție normală standard.

| n \ α | 0,90 | 0,95 | 0,975 | 0,99 | 0,995 | 0,9975 | 0,999 | 0,9995 |

|---|

| 1 | 3,078 | 6.314 | 12.706 | 31,821 | 63.657 | 127,321 | 318.309 | 636.619 |

|---|

| 2 | 1,886 | 2.920 | 4.303 | 6,965 | 9,925 | 14.089 | 22.327 | 31.599 |

|---|

| 3 | 1.638 | 2.353 | 3.182 | 4.541 | 5.841 | 7.453 | 10.215 | 12.924 |

|---|

| 4 | 1,533 | 2.132 | 2,776 | 3,747 | 4.604 | 5.598 | 7.173 | 8.610 |

|---|

| 5 | 1,476 | 2.015 | 2.571 | 3.365 | 4.032 | 4.773 | 5.893 | 6,869 |

|---|

| 6 | 1.440 | 1.943 | 2.447 | 3.143 | 3.707 | 4.317 | 5.208 | 5.959 |

|---|

| 7 | 1.415 | 1,895 | 2.365 | 2.998 | 3.499 | 4.029 | 4.785 | 5.408 |

|---|

| 8 | 1,397 | 1,860 | 2.306 | 2.896 | 3.355 | 3.833 | 4.501 | 5.041 |

|---|

| 9 | 1,383 | 1,833 | 2.262 | 2.821 | 3.250 | 3,690 | 4.297 | 4.781 |

|---|

| 10 | 1,372 | 1.812 | 2.228 | 2.764 | 3.169 | 3,581 | 4.144 | 4.587 |

|---|

| 11 | 1.363 | 1.796 | 2.201 | 2.718 | 3.106 | 3,497 | 4.025 | 4.437 |

|---|

| 12 | 1,356 | 1.782 | 2.179 | 2.681 | 3.055 | 3.428 | 3.930 | 4.318 |

|---|

| 13 | 1.350 | 1.771 | 2.160 | 2.650 | 3.012 | 3,372 | 3,852 | 4.221 |

|---|

| 14 | 1.345 | 1.761 | 2.145 | 2.624 | 2.977 | 3.326 | 3,787 | 4.140 |

|---|

| 15 | 1,341 | 1,753 | 2.131 | 2.602 | 2.947 | 3.286 | 3.733 | 4.073 |

|---|

| 16 | 1.337 | 1.746 | 2.120 | 2,583 | 2.921 | 3.252 | 3,686 | 4.015 |

|---|

| 17 | 1.333 | 1.740 | 2.110 | 2,567 | 2.898 | 3.222 | 3,646 | 3,965 |

|---|

| 18 | 1.330 | 1.734 | 2.101 | 2.552 | 2.878 | 3.197 | 3.610 | 3,922 |

|---|

| 19 | 1.328 | 1.729 | 2.093 | 2.539 | 2.861 | 3.174 | 3,579 | 3,883 |

|---|

| 20 | 1.325 | 1,725 | 2.086 | 2.528 | 2.845 | 3.153 | 3,552 | 3.850 |

|---|

| 21 | 1.323 | 1.721 | 2.080 | 2.518 | 2.831 | 3.135 | 3,527 | 3.819 |

|---|

| 22 | 1.321 | 1.717 | 2,074 | 2.508 | 2.819 | 3.119 | 3.505 | 3,792 |

|---|

| 23 | 1.319 | 1.714 | 2.069 | 2.500 | 2.807 | 3.104 | 3,485 | 3,768 |

|---|

| 24 | 1.318 | 1.711 | 2.064 | 2.492 | 2,797 | 3.091 | 3.467 | 3,745 |

|---|

| 25 | 1.316 | 1,708 | 2.060 | 2.485 | 2,787 | 3,078 | 3.450 | 3,725 |

|---|

| 26 | 1.315 | 1,706 | 2.056 | 2,479 | 2,779 | 3,067 | 3.435 | 3.707 |

|---|

| 27 | 1.314 | 1,703 | 2.052 | 2.473 | 2,771 | 3.057 | 3.421 | 3,690 |

|---|

| 28 | 1.313 | 1,701 | 2.048 | 2.467 | 2.763 | 3.047 | 3.408 | 3,674 |

|---|

| 29 | 1.311 | 1.699 | 2.045 | 2.462 | 2.756 | 3.038 | 3,396 | 3.659 |

|---|

| 30 | 1.310 | 1,697 | 2.042 | 2.457 | 2.750 | 3.030 | 3,385 | 3,646 |

|---|

| 40 | 1.303 | 1,684 | 2.021 | 2.423 | 2.704 | 2.971 | 3.307 | 3,551 |

|---|

| 50 | 1.299 | 1,676 | 2.009 | 2.403 | 2,678 | 2.937 | 3.261 | 3,496 |

|---|

| 60 | 1.296 | 1,671 | 2.000 | 2.390 | 2.660 | 2,915 | 3.232 | 3.460 |

|---|

| 100 | 1.290 | 1.660 | 1.984 | 2,364 | 2.626 | 2.871 | 3.174 | 3.390 |

|---|

| ∞ | 1.282 | 1.645 | 1.960 | 2.326 | 2,576 | 2.807 | 3.090 | 3.291 |

|---|

Notă

- ^ ( EN ) Simon Hurst, The Characteristic Function of the Student-t Distribution , in Financial Mathematics Research Report No. FMRR006-95, Statistics Research Report No. SRR044-95 (archiviato dall' url originale il 18 febbraio 2010) .

- ^ ( EN ) Student ( William Sealy Gosset ), The probable error of a mean ( PDF ), in Biometrika , vol. 6, n. 1, marzo 1908, pp. 1–-25, DOI : 10.1093/biomet/6.1.1 .

- ^ ( EN ) Ronald Fisher , Applications of "Student's" distribution ( PDF ), in Metron , vol. 5, 1925, pp. 90-–104 (archiviato dall' url originale il 13 aprile 2011) .

- ^ Valori critici calcolati con la funzione qt(p,g) di R .

Voci correlate

Altri progetti

Collegamenti esterni

Wikimedia Commons contiene immagini o altri file su Distribuzione t di Student

Wikimedia Commons contiene immagini o altri file su Distribuzione t di Student

![{\ displaystyle (N-1) S ^ {2} = \ sum _ {i} (X_ {i} - \ mu) ^ {2} + N ({\ bar {X}} - \ mu) ^ {2 } -2 ({\ bar {X}} - \ mu) \ sum _ {i} (X_ {i} - \ mu) = \ sum _ {i} (X_ {i} - \ mu) ^ {2} + N ({\ bar {X}} - \ mu) ^ {2} -2 ({\ bar {X}} - \ mu) \ left [-N \ mu + \ sum _ {i} X_ {i} \ dreapta]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cd62d94edd82ec0b11ead231f41fc6938fde2251)

![{\ displaystyle \ left [\ {\ bar {X}} - q _ {\ beta} {\ sqrt {S_ {n} ^ {2} / n}} \, \ {\ bar {X}} - q _ {\ alpha} {\ sqrt {S_ {n} ^ {2} / n}} \ \ right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ad437676d3defad2cdb4d7fb9005965248d37ce5)

![{\ displaystyle \ left [\ {\ bar {X}} - z _ {\ alpha} {\ sqrt {S_ {n} ^ {2} / n}} \, \ {\ bar {X}} + z _ {\ alpha} {\ sqrt {S_ {n} ^ {2} / n}} \ \ right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/262da260be336a9680367d4e51aeec6c90267d66)